近日,人工智能学院“人工智能与安全团队”在大模型安全方面又取得新的研究进展,相关成果《A Multimodal Adversarial Attack Method via Frequency Domain Enhancement and Fine-Grained Cross-Modal Guidance》在线发表于IEEE Transactions on Dependable and Secure Computing (TDSC)。钱亚冠教授为第一作者,鲍琦琦博士和哈尔滨工业大学顾钊铨教授为通讯作者。

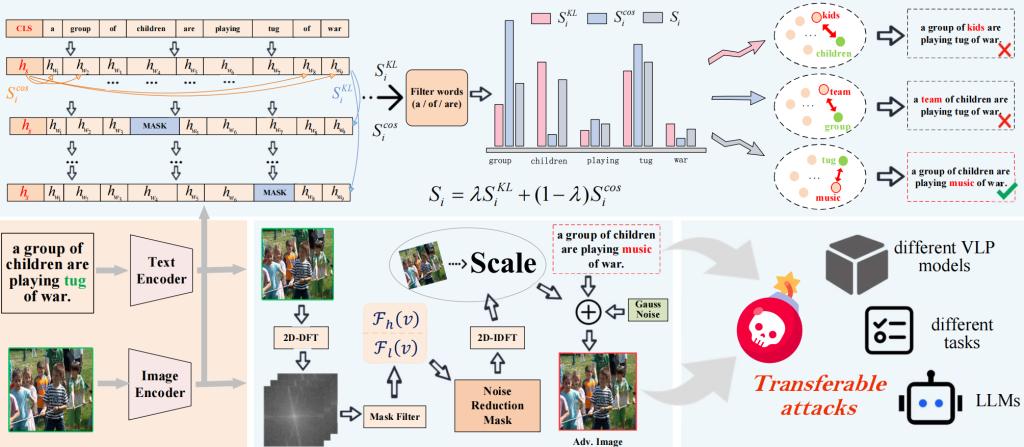

视觉-语言预训练(Vision-language pretraining, VLP)模型在图文理解任务中展现出卓越性能,但仍极易受到可迁移对抗性攻击的影响。针对其局限性,论文提出一种基于频域调整的对抗性攻击方法。此外,研究还引入细粒度特征提取技术,用于优化图文对齐,进一步提升跨模态攻击的可迁移性。实验结果表明,在 Flickr30K 和 MSCOCO 数据集上,针对融合模型(fusion models)与对齐模型(alignment models)这两大 VLP 架构,以及多个任务的测试中,所提方法均实现了更优异的攻击可迁移性与泛化性能。

TDSC是中国人工智能学会(CAAI)、中国计算机学会(CCF)共同推荐的A类期刊,在网络安全领域享有极高的学术声誉。本研究工作得到了国家重点研发计划项目、国家自然科学基金面上项目、浙江省自然科学基金重点项目等的资助。(人工智能学院 袁园)